AAA2020 可解释人工智能(XAI) 从理论到实践的全景透视

近年来,人工智能技术飞速发展,但在实际应用中,模型的“黑箱”特性成为制约其广泛应用的关键挑战。AAA2020会议上发布的230页PPT,系统性地阐述了可解释人工智能(XAI)从基础理论到工业应用的全过程,为开发者和研究者提供了重要参考。

XAI的基础理论部分首先回顾了传统机器学习模型的可解释性瓶颈,深入分析了决策树、线性模型等传统可解释方法,并引入深度学习中的注意力机制、对抗样本解释、局部可解释模型(LIME)和SHAP等前沿技术。这些理论不仅涵盖了模型透明度的数学原理,还强调了在模型复杂性和可解释性之间取得平衡的重要性。

在工业应用层面,PPT详细展示了XAI在医疗诊断、金融风控、自动驾驶和智能制造等领域的实际案例。例如,在医疗影像分析中,XAI技术能够可视化模型关注的关键区域,帮助医生理解AI的诊断依据;在金融领域,可解释的信用评分模型提升了监管合规性和用户信任度。这些应用不仅验证了XAI技术的实用性,还突显了其在解决现实问题中的巨大潜力。

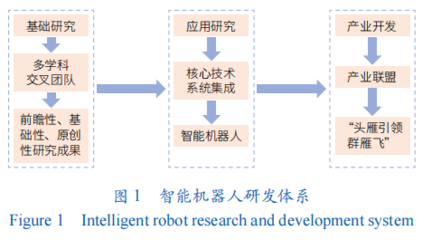

XAI的落地并非一帆风顺。PPT中总结了实际挑战,包括模型精度与可解释性的权衡、计算资源的高消耗、跨领域可解释标准的缺失,以及用户对解释结果的理解差异等。经验教训部分指出,成功的XAI项目需要多学科团队协作,结合领域知识设计解释方法,并在开发早期就将可解释性纳入系统设计考量。

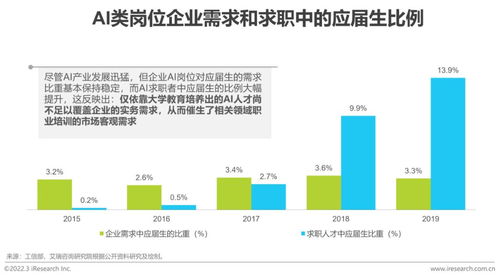

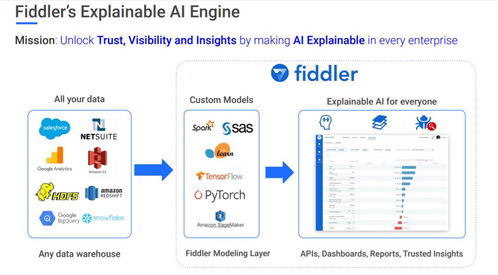

PPT强调了人工智能基础软件开发在推动XAI普及中的关键作用。开源工具如TensorFlow Explainability和InterpretML降低了XAI的应用门槛,而企业级平台则通过集成可视化界面和自动化解释生成,进一步提升了开发效率。未来,随着法规对AI透明度的要求日益严格,XAI必将在人工智能生态中扮演更加核心的角色。

AAA2020的这份资料不仅是一份技术指南,更是一张连接理论研究与产业实践的路线图,为构建可信、可靠的人工智能系统提供了坚实基础。

如若转载,请注明出处:http://www.sdlowma.com/product/25.html

更新时间:2025-11-29 12:38:52